SSIS como un servicio cluster independiente

Si se elige esta opción habrá que:

- Crear un recurso de disco físico específico para almacenar la información que permitirá la emulación del cluster. O lo que es lo mismo, definir un sitio donde almacenar los archivos y los paquetes comunes de la configuración (si se decide almacenarlos en un disco físico en vez de una base de datos MSDB).

-

Identifique una dirección IP estática y nómbrelo para el servicio de SSIS. Este punto es válido si no se va a utilizar un grupo existente del cluster.

Una vez identificada la información anterior se puede proceder a la creación del grupo.

-

Abrir la consola de administración del cluster en cualquiera de los nodos.

-

Añadir una nueva aplicación

-

Añadir los siguientes recursos:

-

Un disco compartido.

-

Un nombre de red.

-

Una dirección IP estática.

-

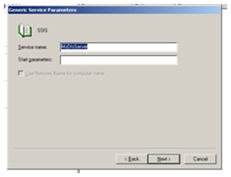

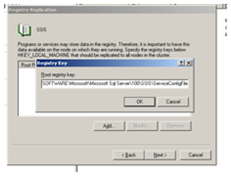

Un servicio genérico. Éste es el elemento más interesante porque definirá el servicio cluster de SSIS. Este recurso tendrá dependencias en la dirección IP y el disco compartido, si estos recursos no están disponibles, entonces el servicio no podrá activarse. Para configurar con éxito este recurso hay que definir el nombre y la clave del registro de Windows (verificar la localización de la clave del registro en su servidor) que se utilizará como se muestra en el Cuadro 5 y el Cuadro 6.

Cuadro 5 – Ventana de parámetros del servicio genérico

-

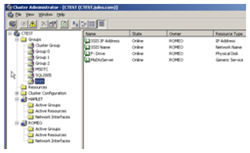

Ahora solo hay que activar el grupo de recursos. La consola tendrá un aspecto parecido a la que se muestra en el Cuadro 7.

-